кластер для параллельный вычислений

Модераторы: Trinity admin`s, Free-lance moderator`s

кластер для параллельный вычислений

Есть задача собрать небольшой кластер для вычислений на платформе CUDA (планируется использовать в каждом компьютере кластера Nvidia Tesla s1070)

Сейчас хотим купить 4 компьютера с перспективой расширения кластера до 10 машин.

Входная информация для вычислений - 10(в будущем 20) линков гигабитного Ethernet, по которым идёт поток данных 5(в будущем 10)Гбит/c.

В текущем варинате желательно обеспечить поток данных между узлами кластера - не менее 10Гбит/c одновременно между любыми двумя узлами.

Поэтому в качестве межузлового интерфейса хотим взять какой нибудь быстрый InfiniBand (напр. 4x QDR), чтобы с запасом на вариант расширения кластера обеспечить нужную пропускную способность.

Не совсем ясно за счёт какого устройства обеспечить раздачу входных данных (линков Ethernet на все узлы кластера) т.е. хотелось бы услышать Ваше мнение по поводу организации шлюза с 20 линков 1Gbit Ehternet на 10 линков InfiniBаnd.

Также хотелось бы подобрать конфигурацию сервера с оценкой стоимости под такие задачи. Примерная конфигурация узла:

- процессор - Xeon (какой-нибудь старший с поддержкой QuickPath)

- память - самая быстрая из доступных 32Гбайт

- HDD 2TB SATA 2шт. в mirror raid

- карточка InfiniBand 4xQDR

- 1(лучше 2) свободных разъема PCIe x16 (лучше 2.0) для подключения NVIDIA Tesla s1070

В качестве операционной системы кластера будет Linux, следовательно hardware сервера должно иметь под него нормальные драйвера. (хотя я так понимаю драйвера для карточек InfiniBand делаются в первую очередь именно для Linux).

Да, такой ещё вопрос - c InfiniBand на практике не сталкивался, в инете про него написано, что бывает через медь или через оптику, причём оптика в последнее время чуть ли не дешевле меди. Хотелось бы всё таки разобраться какое из этих решений обычно используется для связи на небольших расстояниях и какое лучше подойдёт для решения данной задачи.

Сейчас хотим купить 4 компьютера с перспективой расширения кластера до 10 машин.

Входная информация для вычислений - 10(в будущем 20) линков гигабитного Ethernet, по которым идёт поток данных 5(в будущем 10)Гбит/c.

В текущем варинате желательно обеспечить поток данных между узлами кластера - не менее 10Гбит/c одновременно между любыми двумя узлами.

Поэтому в качестве межузлового интерфейса хотим взять какой нибудь быстрый InfiniBand (напр. 4x QDR), чтобы с запасом на вариант расширения кластера обеспечить нужную пропускную способность.

Не совсем ясно за счёт какого устройства обеспечить раздачу входных данных (линков Ethernet на все узлы кластера) т.е. хотелось бы услышать Ваше мнение по поводу организации шлюза с 20 линков 1Gbit Ehternet на 10 линков InfiniBаnd.

Также хотелось бы подобрать конфигурацию сервера с оценкой стоимости под такие задачи. Примерная конфигурация узла:

- процессор - Xeon (какой-нибудь старший с поддержкой QuickPath)

- память - самая быстрая из доступных 32Гбайт

- HDD 2TB SATA 2шт. в mirror raid

- карточка InfiniBand 4xQDR

- 1(лучше 2) свободных разъема PCIe x16 (лучше 2.0) для подключения NVIDIA Tesla s1070

В качестве операционной системы кластера будет Linux, следовательно hardware сервера должно иметь под него нормальные драйвера. (хотя я так понимаю драйвера для карточек InfiniBand делаются в первую очередь именно для Linux).

Да, такой ещё вопрос - c InfiniBand на практике не сталкивался, в инете про него написано, что бывает через медь или через оптику, причём оптика в последнее время чуть ли не дешевле меди. Хотелось бы всё таки разобраться какое из этих решений обычно используется для связи на небольших расстояниях и какое лучше подойдёт для решения данной задачи.

Re: кластер для параллельный вычислений

Я вам помогу определиться с конфигурацией только давайте для начала отделим мух от котлет.

Вы очень бодро начали оперировать кластерными потоками данных не представляя что по этим потокам будет идти.

Во первых есть кластерный интерконнект, обычно это тот самый инфинибенд, вот только стек ip для интерконнекта обычно не используется.

Его можно поставить но лишь как вспомогательную надстройку ибо применив стек ip мы теряем в сути интерконнекта (минимальная латентность и максимальная пропускная способность).

Если не планируется на первое время расширение кластера то рекомендую ставить двухпортовые карты инфинибенда, это позволит обойтись без ib коммутатора

Вы очень бодро начали оперировать кластерными потоками данных не представляя что по этим потокам будет идти.

Во первых есть кластерный интерконнект, обычно это тот самый инфинибенд, вот только стек ip для интерконнекта обычно не используется.

Его можно поставить но лишь как вспомогательную надстройку ибо применив стек ip мы теряем в сути интерконнекта (минимальная латентность и максимальная пропускная способность).

Если не планируется на первое время расширение кластера то рекомендую ставить двухпортовые карты инфинибенда, это позволит обойтись без ib коммутатора

t.me: @RoboforumSetar ; st@3nt.ru

Re: кластер для параллельный вычислений

во вторых есть ip поток данных , от клиентов, это совсем другая вещь

как правило этот поток не нужен при работе кластера он бывает при постановке задачи и заборе результатов.

Вообще рекомендую четко описать задачу, чтобы избежать ситуации получения решения которое Вам совсем не подходит

как правило этот поток не нужен при работе кластера он бывает при постановке задачи и заборе результатов.

Вообще рекомендую четко описать задачу, чтобы избежать ситуации получения решения которое Вам совсем не подходит

t.me: @RoboforumSetar ; st@3nt.ru

Re: кластер для параллельный вычислений

Спасибо за разъяснения.

Суть задачи - обработка сигнальных данных радиолокационной системы. Вообще говоря такие задачи решаются на спецвычислителях (построенных на сигнальных процессорах, ПЛИС и пр.), но стоимость их разработки довольно высокая. Поэтому хочется сначала обкатать алгоритмы на универсальном вычислителе.

Данные от клиентов поступают постоянно, по ряду причин обработка в нереальном времени не подходит, отсюда требования ко входному потоку данных 5Гбит/c (выходной поток данных на 3-4 порядка меньше, его можно не учитывать). Для формирования потока используется несколько приёмников с Ethernet выходом.

Этот входной поток нужно завести на вход каждого узла кластера.

InfiniBand в первую очередь выбран из-за пропускной способности, задержки не так важны, хочется также услышать Ваше мнение о возможности применения 10Gbit Ethernet для решения данной задачи.

Суть задачи - обработка сигнальных данных радиолокационной системы. Вообще говоря такие задачи решаются на спецвычислителях (построенных на сигнальных процессорах, ПЛИС и пр.), но стоимость их разработки довольно высокая. Поэтому хочется сначала обкатать алгоритмы на универсальном вычислителе.

Данные от клиентов поступают постоянно, по ряду причин обработка в нереальном времени не подходит, отсюда требования ко входному потоку данных 5Гбит/c (выходной поток данных на 3-4 порядка меньше, его можно не учитывать). Для формирования потока используется несколько приёмников с Ethernet выходом.

Этот входной поток нужно завести на вход каждого узла кластера.

InfiniBand в первую очередь выбран из-за пропускной способности, задержки не так важны, хочется также услышать Ваше мнение о возможности применения 10Gbit Ethernet для решения данной задачи.

-

hitower

- Сотрудник Тринити

- Сообщения: 357

- Зарегистрирован: 23 дек 2007, 15:35

- Откуда: Москва

- Контактная информация:

Re: кластер для параллельный вычислений

Не совсем понятно - в процессе обработки данных узлы общаются между собой? Если да, наверняка каике-то требования к задержке имеются.

Re: кластер для параллельный вычислений

Да, узлы общаются, но они обмениваются сравнительно большими кусками данных.

По предварительным оценкам задержки в десятки-сотни микросекунд приемлемы.

Причём возможен вариант работы системы когда узлы работают независимо, но на каждый узел в этом случае нужно завести весь исходный поток данных.

По предварительным оценкам задержки в десятки-сотни микросекунд приемлемы.

Причём возможен вариант работы системы когда узлы работают независимо, но на каждый узел в этом случае нужно завести весь исходный поток данных.

-

hitower

- Сотрудник Тринити

- Сообщения: 357

- Зарегистрирован: 23 дек 2007, 15:35

- Откуда: Москва

- Контактная информация:

Re: кластер для параллельный вычислений

С такими задержками лучше не заморачиваться с Ethernet 10G внутри кластера, сразу подумать об инфинибэнде.

- MrCloud

- Advanced member

- Сообщения: 99

- Зарегистрирован: 22 июн 2006, 12:05

- Откуда: Москва

- Контактная информация:

Re: кластер для параллельный вычислений

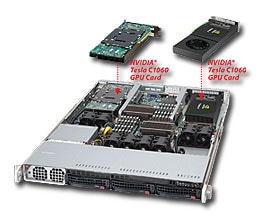

Да, и оптимальные для этого платформы у нас есть:

http://blog.trinitygroup.ru/2009/08/sup ... f-tc2.html обзор.

и

Можно потрогать , обе на следующей неделе будут демонстрироваться на выставке НАТэкспо в ВДНХ, как сервера для видеообработки и кодирования HD/SuperHD видео.

, обе на следующей неделе будут демонстрироваться на выставке НАТэкспо в ВДНХ, как сервера для видеообработки и кодирования HD/SuperHD видео.

InfiniBand адаптер есть куда вставить в обоих.

http://blog.trinitygroup.ru/2009/08/sup ... f-tc2.html обзор.

и

Можно потрогать

InfiniBand адаптер есть куда вставить в обоих.

Re: кластер для параллельный вычислений

Это конечно всё хорошо, но поток входных данных 5Гбит/c через 10 линков 1Gbit Ethernet, причём эти 5Гбит/c нужно завести на вход каждого узла.

Т.е. нужен некий конвертер Ethernet -> Infiniband. Есть ли готовые промышленные решения для этого?

Т.е. нужен некий конвертер Ethernet -> Infiniband. Есть ли готовые промышленные решения для этого?

- gs

- Сотрудник Тринити

- Сообщения: 16650

- Зарегистрирован: 23 авг 2002, 17:34

- Откуда: Москва

- Контактная информация:

Re: кластер для параллельный вычислений

А что мешает завести входной поток прямо по эзернету, а инфинибанд использовать только как интерлинк?

Решения-то есть, но Вы говорили, что экономить хотите?

Какова вообще цена вопроса, хотя бы порядок?

Решения-то есть, но Вы говорили, что экономить хотите?

Какова вообще цена вопроса, хотя бы порядок?

- MrCloud

- Advanced member

- Сообщения: 99

- Зарегистрирован: 22 июн 2006, 12:05

- Откуда: Москва

- Контактная информация:

Re: кластер для параллельный вычислений

Т.е. входные данные приходят по IP, а Infiniband нужен для уже совместной работы серверов между собой?Dblmok писал(а):Это конечно всё хорошо, но поток входных данных 5Гбит/c через 10 линков 1Gbit Ethernet, причём эти 5Гбит/c нужно завести на вход каждого узла.

Т.е. нужен некий конвертер Ethernet -> Infiniband. Есть ли готовые промышленные решения для этого?

Это будет зависеть от Вашего софта, например если оптимизировать, то достаточно одного сервера с 10Gbe картой и инфинибэнд который бы распределял задачи по остальным.

Ну или в каждый сервер по + Eth карте 10Gb. В 1U правда 2 2х слотовые карты уже не включишь 8(

Re: кластер для параллельный вычислений

Цена вопроса: 1-2 млн. руб (экономия понятие относительное)

А что за решения о которых Вы говорите?

А что за решения о которых Вы говорите?

- exLH

- Сотрудник Тринити

- Сообщения: 5061

- Зарегистрирован: 11 фев 2004, 15:49

- Откуда: Москва

- Контактная информация:

Re: кластер для параллельный вычислений

Конечно есть! Например, Mellanox BridgeX BX4010.Dblmok писал(а):Т.е. нужен некий конвертер Ethernet -> Infiniband. Есть ли готовые промышленные решения для этого?

Правда стоит примерно в 25-50% от Вашего бюджета...

А в чем проблема поставить обычный коммутатор с 10Гбит портами и серверы подключать по 10Гбит, а не через пучек гигабитных портов?

У Вас уже софт есть, который Вы планируете там гонять?

Почтовый адрес для связи: a.ivanov@trinitygroup.ru | ICQ: 112586598

Re: кластер для параллельный вычислений

Да в принципе ничего не мешает сделать так.exLH писал(а): А в чем проблема поставить обычный коммутатор с 10Гбит портами и серверы подключать по 10Гбит, а не через пучек гигабитных портов?

У Вас уже софт есть, который Вы планируете там гонять?

Если "обычный 10 Гигабитный коммутатор" сильно дешевле девайса от Mellanox, то наверно так и сделаем.

Софт как всегда в бесконечном процессе разработки, проблема в том, что алгоритмы и софт как раз таки и нужно обкатать и есть разные варианты построения системы (т.е. вполне возможно что в конечном варианте обработка данных узлами будет осуществляться независимо и InfiniBand как интерлинк вообще не нужен).

Коммечерское предложение пусть даже очень примерное по вышенаписанному можно получить или ещё нужны какие-то данные?

Re: кластер для параллельный вычислений

Задача знакомая, я разворачивал комплекс спецвычислителя на ПЛИС

кстати от универсального обработчика Вам не уйти, он нужен и после перекладывания задачи на ПЛИС

Поскольку тема обсуждения закрытая, предлагаю пообщатся по телефону на недельке.

+7 (812) 327 59 60 #2205 - Сергей Тараненко

кстати от универсального обработчика Вам не уйти, он нужен и после перекладывания задачи на ПЛИС

Поскольку тема обсуждения закрытая, предлагаю пообщатся по телефону на недельке.

+7 (812) 327 59 60 #2205 - Сергей Тараненко

t.me: @RoboforumSetar ; st@3nt.ru

Кто сейчас на конференции

Сейчас этот форум просматривают: нет зарегистрированных пользователей и 24 гостя